Madrid, 27 ottobre 2025. In Codere, continuiamo a compiere progressi costanti nella conoscenza e nell’adozione dell’Intelligenza Artificiale (IA) da diverse prospettive. Ma oltre al suo sviluppo in applicazioni o processi, è essenziale capire cosa si nasconde dietro questa tecnologia dirompente, che trasformerà il nostro modo di lavorare e prendere decisioni in azienda. Partiamo oggi con una serie di articoli dedicati al Modello di IA in Codere che potrete seguire nei prossimi numeri di questa pubblicazione.

L’intelligenza artificiale è diventata una delle tecnologie più rilevanti del XXI secolo, grazie alla sua enorme capacità di elaborazione e analisi dei dati. Le sue possibilità sono immense: consente l’automazione dei processi, l’aumento della produttività e l’ottimizzazione delle decisioni. Ma comporta anche sfide significative che non possono essere ignorate: trasparenza, etica e sicurezza nell’ambito del suo sviluppo e utilizzo.

Risolvere queste sfide è stato proprio uno degli obiettivi del Regolamento sull’intelligenza artificiale (RIA o AI Act), entrato in vigore nell’agosto 2024 e che stabilisce un quadro pionieristico per garantire che l’intelligenza artificiale sia sviluppata e utilizzata in modo sicuro, trasparente e nel rispetto dei diritti fondamentali.

Si tratta del primo regolamento vincolante al mondo che disciplina in modo completo questa tecnologia, direttamente applicabile e obbligatorio in tutti gli Stati membri dell’Unione Europea. La Spagna sta già predisponendo una legge nazionale di accompagnamento (“Legge per il buon uso e la governance dell’IA”) per allineare il quadro normativo europeo a quello nazionale e definire le autorità competenti.

Inoltre, in America Latina, diversi Paesi in cui opera il nostro gruppo stanno sviluppando normative ispirate al modello europeo, pertanto la conformità all’IA sarà uno sforzo globale e trasversale per l’intera organizzazione.

IA in Codere, punto di partenza

In Codere stiamo progettando un solido modello di governance dell’IA che garantisca la conformità normativa, la gestione del rischio e un processo decisionale informato, promuovendo al contempo l’efficienza e la standardizzazione dei processi in tutta l’organizzazione.

Il coordinamento operativo avviene attraverso l’Ufficio Tecnico IA (AITO – AI Technical Office) di recente creazione, che si basa su tre pilastri complementari: compliance, tecnico e di business, guidato dal dipartimento Architettura di Impresa.

Il modello, affinchè funzioni, si basa su strumenti chiave di conformità e controllo: una Politica Corporativa sull’uso dell’IA, applicabile a livello globale in Spagna, Italia e America Latina, che stabilirà i principi, le responsabilità e i controlli necessari per un uso etico, sicuro e responsabile dell’IA all’interno del gruppo; una matrice RACI, che definisce ruoli e responsabilità; e altri strumenti che compongono il quadro normativo interno, come la procedura per la categorizzazione di nuove iniziative o la procedura per la segnalazione di incidenti relativi all’IA.

Il RIA ha una portata globale in Codere, come già avviene per la normativa sulla protezione dei dati. Applichiamo gli standard UE più avanzati, adattandoli alle normative locali, per ottenere lo stesso livello di condizioni e responsabilità in tutti i paesi del Gruppo.

Sì a una IA Responsabile

Con il quadro normativo ora in vigore, Codere sta procedendo con l’implementazione graduale del suo Modello di Governance dell’IA, in linea con le tappe obbligatorie del RIA.

Dal 2 febbraio 2025 tutte le aziende dovranno rispettare due obblighi fondamentali:

- Formazione in IA: Tutti coloro che utilizzano o gestiscono sistemi di intelligenza artificiale devono avere una conoscenza adeguata di questa tecnologia e delle sue implicazioni. Codere lancerà presto un programma di alfabetizzazione e formazione specializzato per sette gruppi interni, personalizzato in base al livello di esposizione di ciascun gruppo.

- Divieto di sistemi di IA con rischio inaccettabile: Dal 2 febbraio, l’articolo 5 del RIA proibisce espressamente determinati utilizzi dell’IA, come la manipolazione subliminale, la valutazione sociale o l’identificazione biometrica in tempo reale.

Pertanto, ogni iniziativa di intelligenza artificiale in Codere sarà sottoposta a un processo di autorizzazione legale e trasversale, che ne garantirà la sicurezza e la conformità normativa prima dell’implementazione.

Pertanto, ogni iniziativa di intelligenza artificiale in Codere sarà sottoposta a un processo di autorizzazione legale e trasversale, che ne garantirà la sicurezza e la conformità normativa prima dell’implementazione.

Javier Lomas, Direttore Compliance IA (CAIO), sottolinea: “L’intelligenza artificiale non è una tecnologia qualsiasi. La sua capacità di trasformare le organizzazioni e avere un impatto sulle persone richiede di gestirla con rigore, etica e responsabilità. Rispettare la legge non è solo un obbligo; è un modo di fare le cose in modo corretto”.

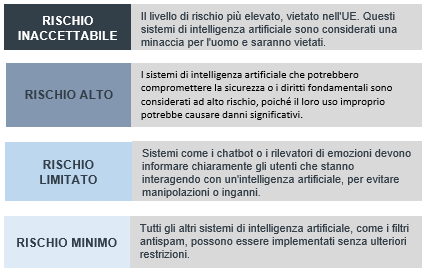

Nella tabella seguente sono categorizzati i diversi livelli di rischio e gli usi vietati stabiliti dalla RIA e le relative possibili sanzioni, che possono arrivare fino a 35 milioni di euro o al 7% del fatturato totale, per le violazioni più gravi dei divieti di uso inaccettabile:

L’impegno responsabile di Codere nei confronti dell’IA va oltre la semplice conformità normativa e comprende i seguenti requisiti:

- Applicare la Politica Corporativa dell’IA e il Modello di Governance

- Registrare i casi d’uso, valutare i rischi e tutelare le persone

- Comunicar de forma transparente cuándo hay IA Comunicare in modo trasparente quando si utilizza l’IA

- Potenziare la sicurezza e la qualità dei dati

- Formare tutto il personale in materia di alfabetizzazione in IA

- E, in generale, rispettare le normative sull’IA in tutte le operazioni del Gruppo.